Im März 2026 berichtete die BBC über das, was sie als Wettlauf um ein Logo für KI-freie Inhalte bezeichnete. Weltweit arbeiten inzwischen mindestens acht verschiedene Organisationen im Vereinigten Königreich, in Australien und in den USA an konkurrierenden Zertifizierungsmodellen für Produkte, die ohne künstliche Intelligenz entstanden sind. Labels wie „Proudly Human“, „No AI“ oder „Human Written“ tauchen bereits auf Filmen, Büchern, Websites und in Marketingmaterialien auf.

Das ist ein legitimes und spannendes Marktsignal. Wenn man jedoch aus der Produkt- oder Tech-Perspektive darauf blickt, ist die Sicht der Verbraucher nur die Oberfläche. Die eigentliche, folgenreichere Frage lautet: Was bedeutet es auf Produktebene tatsächlich, ein Label wie „von Menschen gemacht“ zu beanspruchen oder zu verifizieren? Und was setzt ein solches Versprechen für Entwicklungsprozesse, Tool-Entscheidungen und Verantwortungsstrukturen in Gang?

Warum die Label-Frage komplizierter ist, als sie scheint

Die intuitive Definition eines „von Menschen gemachten“ Produkts ist einfach: Menschen haben die Arbeit gemacht, nicht Maschinen. Doch sobald man sich von handgefertigten physischen Gütern entfernt und in die Welt digitaler Produkte, Software, Datenpipelines oder KI-Systeme eintaucht, beginnt diese Definition zu bröckeln.

Die KI-Forscherin Sasha Luccioni bringt es auf den Punkt: KI ist inzwischen so tief in alltägliche Tools und Plattformen integriert, dass es technisch schwierig wird, eine klare Grenze zwischen „KI-unterstützt“ und „KI-frei“ zu ziehen. Rechtschreibkorrekturen, Autocomplete, Grammatik-Tools, Compiler-Optimierungen oder Cloud-Infrastrukturen mit automatischem Scaling – all diese beinhalten auf irgendeiner Ebene maschinelle Intelligenz. Die binäre Unterscheidung greift hier schlicht zu kurz.

Die sinnvollere Frage ist daher nicht „KI oder keine KI“, sondern vielmehr: In welchen Phasen des Produktlebenszyklus und bei welchen Entscheidungsarten macht ein solches Label überhaupt eine Aussage, auf die man zählen kann?

| Das Problem des Spektrums Zertifizierungsstellen für KI bewegen sich bereits weg vom binären Denken hin zu abgestuften Modellen. Die derzeit glaubwürdigsten Ansätze unterscheiden typischerweise zwischen drei Kategorien: – „human-written“ (keine generative KI an der eigentlichen Erstellung beteiligt), – „human-led, AI-assisted“ (der Prozess liegt in menschlicher Hand, KI unterstützt bei der Umsetzung) und – „AI-generated, human-reviewed“ (die KI erstellt das primäre Ergebnis, der Mensch prüft und validiert). Die Herausforderung dabei: „generative KI“ ist selbst keine klar abgegrenzte Kategorie. Was darunter fällt, hängt stark vom jeweiligen Tool, der konkreten Aufgabe und dem Grad der menschlichen Steuerung bzw. Eingriffe ab. |

Das Problem eingebetteter Tools: Wo verläuft die Grenze bei Softwareprodukten?

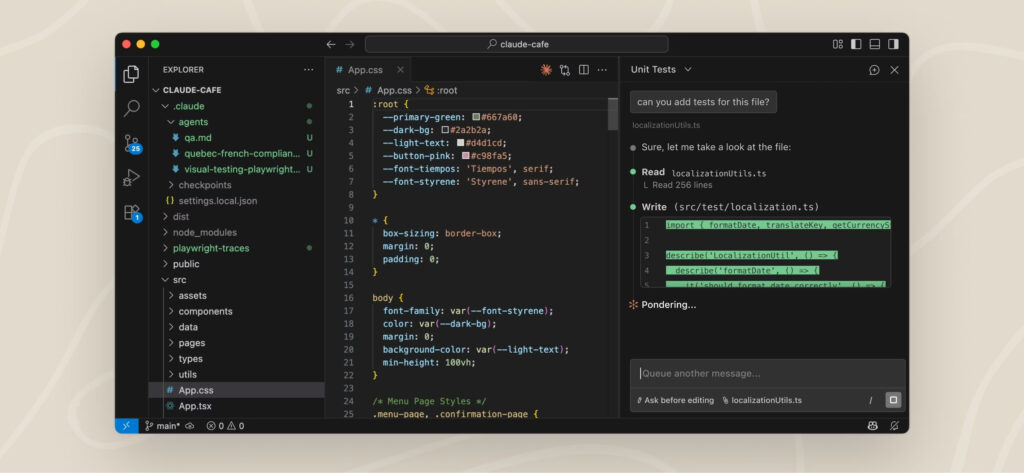

Stell dir ein realistisches Szenario für ein Software- oder Datenproduktteam im Jahr 2026 vor: Deine Entwickler nutzen GitHub Copilot oder Claude Code für die Vervollständigung vom Code, Refactoring und Testgenerierung. Deine Data Engineers arbeiten mit Databricks Genie für Natural-Language-Abfragen und Unterstützung in Notebooks. Deine Dokumentation wird mit KI-Schreibtools erstellt und anschließend von Menschen überarbeitet. Deine QA-Pipeline nutzt KI-basierte Anomalieerkennung.

Die entscheidende Frage: Disqualifiziert irgendetwas davon dein Produkt als „von Menschen gemacht“?

Die Antwort hängt vollständig davon ab, wie du das Label definierst, und genau diese Definitionen sind aktuell alles andere als eindeutig. Ende 2025 gaben rund 85 % der professionellen Entwickler an, regelmäßig KI-gestützte Coding-Tools zu nutzen, mehr als die Hälfte sogar täglich. Allein GitHub Copilot verzeichnete insgesamt über 20 Millionen Nutzer. Tools wie Claude Code oder Databricks Genie sind längst keine Randerscheinung mehr, sondern fester Bestandteil von täglichen Workflows.

Wenn ihre Nutzung bereits als „KI-Beteiligung“ gilt, würde unter einer strengen Auslegung heute kaum noch ein Softwareprodukt als vollständig „human-made“ durchgehen.

Bildquelle: via Claude

Aus diesem Grund fokussieren sich mehrere neue Zertifizierungsinitiativen gezielt auf generative KI: also Tools, die auf Basis von Prompts eigenständig Texte, Code, Bilder, Audio oder Video erzeugen und damit direkt in die eigentliche Inhaltserstellung eingreifen. Unter dieser Perspektive bewegt sich die Nutzung von GitHub Copilot für Inline-Code-Vorschläge in einer eher grauen Zone, verglichen mit Systemen, die mit nur minimaler menschlicher Steuerung eigenständig eine Architektur entwerfen, den Code schreiben und die Dokumentation erstellen.

| Eher als „von Menschen gemacht“ einzuordnen | KI-Einsatz eher klar kennzeichnen: |

| Entwickler nutzen KI für Autocomplete und Refactoring-Vorschläge innerhalb von menschlich gesteuertem Code | KI trifft eigenständig Architekturentscheidungen, erstellt komplette Module oder ganze Codebasen bei nur leichter menschlicher Prüfung |

| KI-gestützte Grammatik- oder Rechtschreibprüfung bei von Menschen verfasster Dokumentation | KI generiert primäre Dokumentation, Spezifikationen oder nutzerseitige Inhalte direkt aus Prompts |

| Automatisierte Tests und CI/CD-Pipelines, die Probleme erkennen und zur menschlichen Behebung markieren | KI führt Deployments, Rollbacks oder Konfigurationsänderungen autonom und ohne menschliche Freigabe durch |

| KI-gestützte Infrastruktur-Skalierung auf Basis von von Menschen definierten Parametern | KI-Systeme, die auf proprietären Daten trainiert wurden, erzeugen Outputs, die ohne menschliche Validierung direkt ins Produkt einfließen |

Was ein „Human-Made“-Versprechen tatsächlich im Produktlebenszyklus verändert

Hier wird es für Produktmanager wirklich relevant: Wenn sich ein Unternehmen entscheidet, ein „human-made“-Label zu beanspruchen (egal ob aus regulatorischen, kommerziellen oder ethischen Gründen), dann ist das keine reine Marketingentscheidung, sondern vielmehr eine prozessuale Einschränkung, die sich durch den gesamten Entwicklungsprozess zieht.

1. Anforderungen und Umfang

Die erste Auswirkung zeigt sich, wenn KI-Tools bei der Anforderungsdefinition, der Auswertung von User Research oder bei der Erstellung von Produktspezifikationen unterstützen. Wenn dein PM-Team KI nutzt, um Nutzerfeedback zusammenzufassen und thematisch zu bündeln oder Feature Specs zu generieren, muss das offengelegt und eingeordnet werden. Die zentrale Frage ist dabei nicht nur, ob ein Mensch das Ergebnis überprüft hat, sondern: Hat der Mensch eigenständige inhaltliche Entscheidungen getroffen oder lediglich das bestätigt, was das System vorgeschlagen hat?

2. Design und Architektur

KI-gestützte Design-Tools, die zum Beispiel das UI generieren, werden immer häufiger in frühen Produktphasen eingesetzt. Ein glaubwürdiges „human-made“-Label würde hier erfordern, klar zu dokumentieren, was generiert wurde und was aktiv von Menschen entworfen wurde. Gleichzeitig muss sichergestellt werden, dass zentrale strukturelle Entscheidungen aus menschlicher Expertise heraus entstehen.

Das hat direkte Auswirkungen auf Rechte am geistigen Eigentum und Verantwortlichkeit: Wenn eine Architekturentscheidung von einer KI vorgeschlagen und ohne tiefgehende Prüfung übernommen wurde und später zu Sicherheits- oder Performance-Problemen führt, wird die Frage nach der Verantwortung schnell komplex.

3. Entwicklung und Code

Hier ist das Problem eingebetteter Tools am stärksten ausgeprägt. Ein Team, das Tools wie Claude Code oder Databricks Genie intensiv nutzt, müsste plötzlich Dinge klären wie:

- Welcher Anteil der Codebasis ist KI-generiert vs. menschlich geschrieben?

- Welche Komponenten entstanden unter menschlicher Steuerung und welche autonom?

- War die menschliche Prüfung von KI-Code substanziell oder nur oberflächlich?

Diese Dinge werden in derzeitigen Entwicklungsprozessen meist gar nicht richtig erfasst. Ein Label würde hier neue Anforderungen an Tools und Governance schaffen, die aktuell in vielen Teams schlicht nicht existieren.

4. Tests und Validierung

KI-generierte Test-Suites und automatisierte QA-Pipelines werfen eine fast paradoxe Frage auf: Wenn dieselben Systeme sowohl Code als auch Tests generieren – was bedeutet die menschliche Validierung dann überhaupt noch?

Ein glaubwürdiges Label würde verlangen, dass Validierungsentscheidungen klar dokumentiert sind und die Definition von „akzeptabler Performance“ in nachweisbar menschlicher Verantwortung liegt.

5. Dokumentation und Kommunikation

Produktdokumentation, API-Referenzen und nutzerseitige Inhalte gehören zu den Bereichen mit dem höchsten Risiko für nicht offengelegte KI-Generierung. Mehrere „AI-free“-Zertifizierungsansätze setzen genau hier an: zum einen, weil sich generative KI in Texten mit aktuellen Tools vergleichsweise leicht erkennen lässt, und zum anderen, weil Dokumentation direkten Einfluss auf das Vertrauen der Nutzer hat. Ein „human-made“-Label auf einem Produkt, dessen Dokumentation ausschließlich von KI generiert wurde, schafft einen großen Vertrauensverlust.

| Die Verschiebung der Verantwortlichkeit Die operativ wichtigste Konsequenz eines „human-made“-Labels liegt nicht darin, was es verbietet, sondern darin, was du dafür dokumentieren musst. Um ein solches Label glaubwürdig zu beanspruchen, brauchst du eine klare Nachvollziehbarkeit menschlicher Entscheidungen entlang des gesamten Prozesses: Wer hat welche Entscheidung getroffen, auf Basis welcher Informationen und mit welchem Grad an KI-Unterstützung? Genau diese Form von Prozessdisziplin fehlt in vielen agilen Teams bislang, weil KI-Tools meist schrittweise und eher informell eingeführt wurden. Das Label zwingt dich letztendlich zu einer einfachen, aber ziemlich unbequemen Frage: Kannst du es nachweisen? |

Welche KI(-frei)-Zertifizierungen gibt es bereits und welche noch nicht?

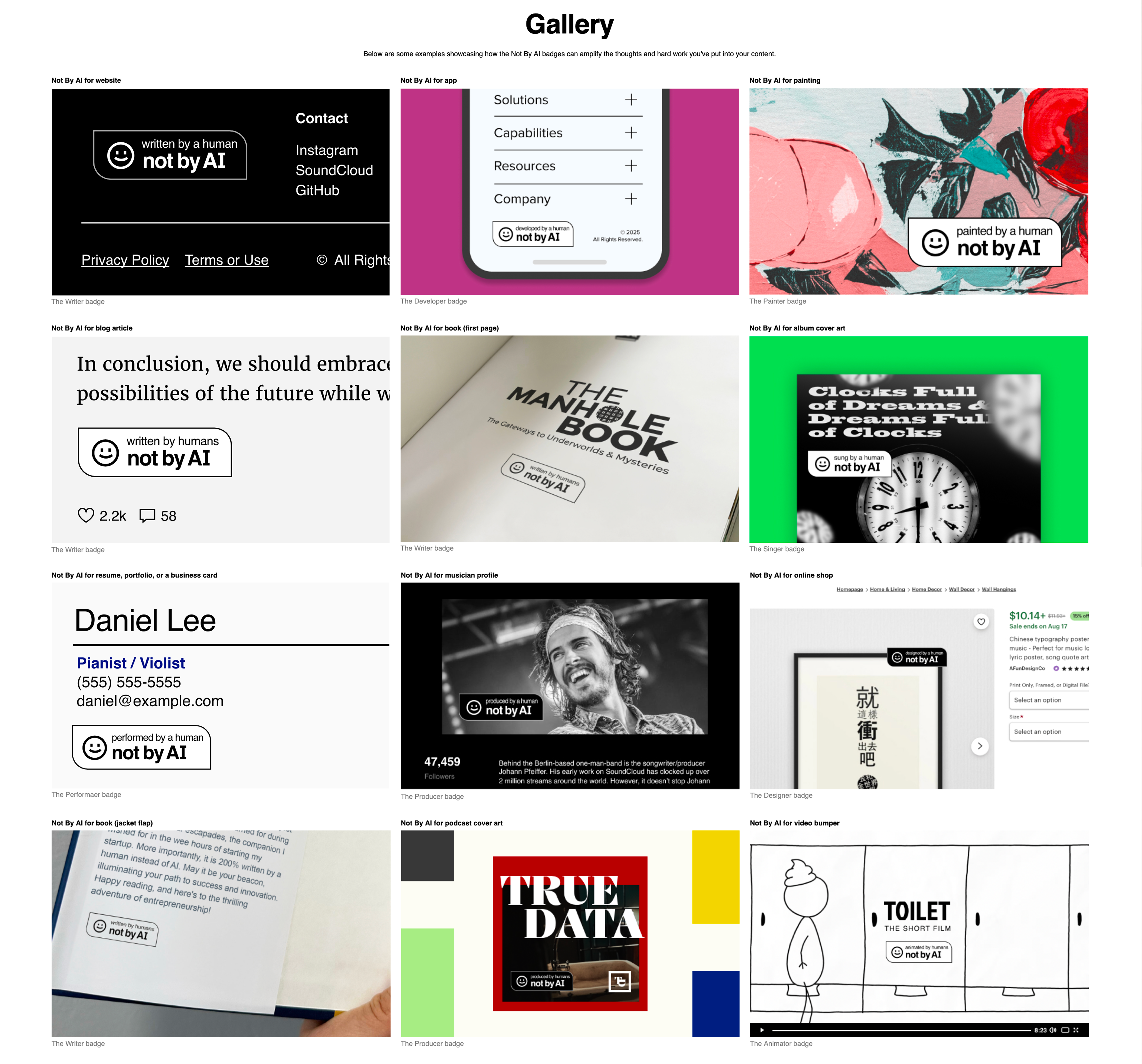

Anfang 2026 ist noch ziemlich unklar, wie solche Zertifizierungen eigentlich aussehen sollen. Bei Plattformen wie no-ai-icon.com und notbyai.fyi können Creator sich ein Label im Grunde selbst geben, mit minimaler oder ohne externe Prüfung. Daneben entstehen aber auch strengere Modelle, zum Beispiel bei aifreecert oder Proudly Human. Hier wird genauer hingeschaut: mit externen Prüfungen, KI-Detektionstools und in der Regel auch gegen Gebühr. Im Publishing-Bereich arbeiten Anbieter wie Books by People mit Fragebögen und prüfen Inhalte stichprobenartig.

Bildquelle: Screenshot der Not By AI Website, https://notbyai.fyi/gallery.

Das Problem: Diese Uneinheitlichkeit sorgt für Verwirrung. Die Konsumforscherin Dr. Amna Khan von der Manchester Metropolitan University weist darauf hin, dass unterschiedliche Definitionen davon, was „human-made“ eigentlich bedeutet, den Markt schon jetzt unübersichtlich machen. Für echtes Vertrauen bräuchte es einen gemeinsamen Standard.

Das oft zitierte Vorbild ist die Fair-Trade-Zertifizierung; allerdings hat es dort Jahrzehnte gedauert, bis sich ein einheitlicher Standard aus vielen konkurrierenden Ansätzen herausgebildet hat (und auch noch mit dem Vorteil, dass physische Lieferketten deutlich leichter nachvollziehbar sind als kreative oder digitale Prozesse).

„Made by Humans“-Zertifizierungen bei Software und Daten

Für Software- und Datenprodukte ist die Sache nochmal deutlich komplizierter. In physischen Lieferketten gibt es längst etablierte Systeme zur Nachverfolgbarkeit: Standards für Herkunftsnachweise, Audit-Strukturen und so weiter. In der digitalen Produktentwicklung fehlt so etwas bisher weitgehend. Es gibt keinen Standard dafür, wie KI-Beteiligung in einer Codebasis dokumentiert wird. Keine einheitliche Einordnung dafür, wie stark KI zu einem Ergebnis beigetragen hat. Und auch keine unabhängige Instanz mit der technischen Tiefe, um komplexe Softwaresysteme zuverlässig auf ihre „KI-Herkunft“ zu prüfen.

Interessant ist, was sich in angrenzenden Bereichen gerade entwickelt. Im Lebenszyklus von Machine-Learning-Modellen wird zunehmend an der Nachverfolgbarkeit gearbeitet. Frameworks wie Atlas setzen auf kryptografisch überprüfbare Nachweise für Herkunft und Entwicklung von Modellen, vom Training bis zum Deployment. Auch aus der Security-Ecke kommen Ansätze, wie zum Beispiel SCITT (Supply Chain Integrity, Transparency and Trust), die mit transparenten, über mehrere Systeme verteilten Protokollen arbeiten.

Alles wichtige Bausteine, aber sie geben noch keine direkte Antwort darauf, wie man auf Produktebene glaubwürdig „human-made“ zertifiziert.

Das Risiko, es falsch zu machen: Label Washing

Das größte Risiko in diesem Bereich ist das, was man als „Label Washing“ bezeichnen könnte: ein „human-made“-Label als reines Marketinginstrument zu nutzen, ohne die nötige Prozessdisziplin dahinter. Einige der aktuellen Zertifizierungsansätze (insbesondere die Modelle zur Selbstzertifizierung) bieten letztlich kaum mehr Sicherheit als das eigene Wort derjenigen, die das Label vergeben.

Für Technologieprodukte kann eine solche Glaubwürdigkeitslücke erhebliche Reputationsschäden nach sich ziehen. Wenn dein Produkt mit „human-made“ wirbt und sich später – etwa durch ein technisches Audit oder investigative Recherchen – herausstellt, dass zentrale Bestandteile ohne Offenlegung von KI generiert wurden, entsteht ein doppelter Vertrauensbruch: Es wurde nicht nur KI eingesetzt, sondern auch der eigene Prozess falsch dargestellt. Strukturell erinnert das stark an Greenwashing im Nachhaltigkeitskontext. Sowohl in der EU als auch in den USA haben Regulierungsbehörden bereits gezeigt, dass sie gegen irreführende Umweltversprechen vorgehen. Es ist daher durchaus zu erwarten, dass auch Aussagen zur KI-Herkunft künftig stärker geprüft werden, je weiter sich der Markt entwickelt.

Eine belastbare Position in diesem Umfeld ist nicht unbedingt ein striktes Label, sondern eine transparente, dokumentierte und überprüfbare Herangehensweise. Einige der überzeugendsten neuen Ansätze arbeiten bereits mit klar definierten Kategorien wie „human-written“, „human-led, AI-assisted“ und „AI-generated, human-reviewed“. Vertrauen entsteht dabei dadurch, dass klar benannt wird, welche Rolle KI gespielt hat, und dass sich dieser Prozess auch nachvollziehen lässt.

Was das konkret für Produktteams bedeutet

Die Diskussion rund um „human-made“-Labels steht noch am Anfang und verpflichtende Zertifizierungen für digitale Produkte sind aktuell keine unmittelbare Realität. Trotzdem sind die Entwicklungen klar genug, um jetzt schon zu handeln. Das können Produktteams heute sinnvoll tun:

- Identifiziere KI-Touchpoints im Produkt.

Bevor du überhaupt Aussagen treffen kannst, musst du wissen, wo KI in deinem Produktlebenszyklus eingesetzt wird: Design, Codegenerierung, Dokumentation, Testing, Data Labeling, Infrastruktur… Die meisten Teams haben das bisher nicht systematisch erfasst. - Definiere eine klare Einordnung für KI-Beteiligung.

Statt in „mit KI/ohne KI“ zu denken, lohnt es sich, intern Kategorien festzulegen:

– Mensch steuert, KI unterstützt in der Ausführung;

– KI liefert Ergebnisse, Mensch prüft;

– KI trifft Entscheidungen ohne relevante menschliche Kontrolle.

Diese Kategorien kannst du dann auf die einzelnen Phasen im Produktlebenszyklus anwenden. - Ermögliche die Nachvollziehbarkeit von Entscheidungen.

Wenn du Tools wie Claude Code oder Databricks Genie nutzt, solltest du prüfen, ob man bei euch klar nachvollziehen kann, welcher Anteil von Menschen und welcher von KI stammt. Das ist keine Kleinigkeit, sondern Infrastruktur – und braucht Zeit. - Formuliere Aussagen bewusst und präzise.

„Erstellt mit KI-Support“ ist oft belastbarer als „human-made“, wenn du Letzteres nicht vollständig belegen kannst. Unklare oder pauschale Aussagen sind in beide Richtungen riskanter als präzise formulierte. - Behalte die Entwicklung von Zertifizierungen im Blick.

Der Markt für KI-Zertifizierungen wird sich voraussichtlich auf wenige Standards fokussieren, mit Schwerpunkt auf Transparenz statt kompletter KI-Vermeidung. Wer sich früh damit beschäftigt, ist im Vorteil.

Ausblick

In den kommenden Monaten wird sich der Markt voraussichtlich auf ein oder zwei glaubwürdige Zertifizierungsstandards zuspitzen. Gleichzeitig ist mit steigenden regulatorischen Anforderungen rund um die Offenlegung von KI in digitalen Produkten zu rechnen.

Für Produktteams liegt die wichtigste Vorbereitung intern: Versteht eure KI-Touchpoints, ordnet eure Tools nach ihrem Beitrag ein und baut Review-Prozesse auf, die echte Nachweise und nicht nur formale Freigaben liefern. Das Ziel ist nicht, einen perfekten „human-made“-Status zu erreichen, denn für die meisten Softwareprodukte ist das weder realistisch noch besonders sinnvoll. Entscheidend ist, klar und belegbar sagen zu können, wo Menschen den Prozess gesteuert haben und wo Maschinen unterstützt haben. Genau diese Klarheit wird von der nächsten Generation von Käufern erwartet.

Quellen

BBC News / Bode Living — The race to establish an AI-free logo (March 2026)

UC Strategies — You may soon have to check this label to know if content was made by a human (2026)

WSJ / Prof. Tzuo-Hann Law — Op-ed: Made by Humans — the strategic value of human labor

Stack Overflow / JetBrains — Developer survey data on AI coding tool adoption (2025)

Faros.ai — Best AI Coding Agents for 2026 (2026)

arxiv / Atlas Framework — Atlas: A Framework for ML Lifecycle Provenance & Transparency (Feb 2025)