Im Gespräch mit Bekannten, beim Scrollen durch Social Media oder auf der Arbeit – der Begriff „Künstliche Intelligenz“, oder kurz „KI“, wird mittlerweile fast inflationär benutzt. Aber könntest du jemandem sofort erklären, was die KI eigentlich ist? Und was unterscheidet sie von Machine Learning (ML) und Deep Learning (DL)?

In diesem Artikel schauen wir uns die Begriffe und ein paar konkrete Beispiele einmal genauer an. Mit der fachlichen Unterstützung meines Kollegen Marshall Mykietyshyn, der als Data Scientist bei diconium data arbeitet, finden wir Antworten auf Fragen, die dir vielleicht auch schon durch den Kopf gegangen sind.

Dieser Artikel beschäftigt sich tiefergehend mit den Grundlagen der KI. Falls du bereits ein KI-Experte bist, lies gerne unsere anderen, spezifischeren Blogartikel!

Kurzer Überblick über die Unterschiede zwischen KI, Machine Learning, Deep Learning und Generativer KI

Diese Technologien spielen bereits eine große Rolle bei der Entwicklung von intelligenten Maschinen, neuen Produkten oder Anwendungen, wie etwa unserer KI-basierten Produktsuche. Sie sind fester Bestandteil der täglichen Arbeit zahlreicher Unternehmen weltweit, beeinflussen aber auch unser tägliches Leben, beispielsweise bei der Nutzung von Tools wie Siri oder ChatGPT. Daher ist es durchaus sinnvoll, zumindest im Groben zu verstehen, was im Hintergrund alles passiert.

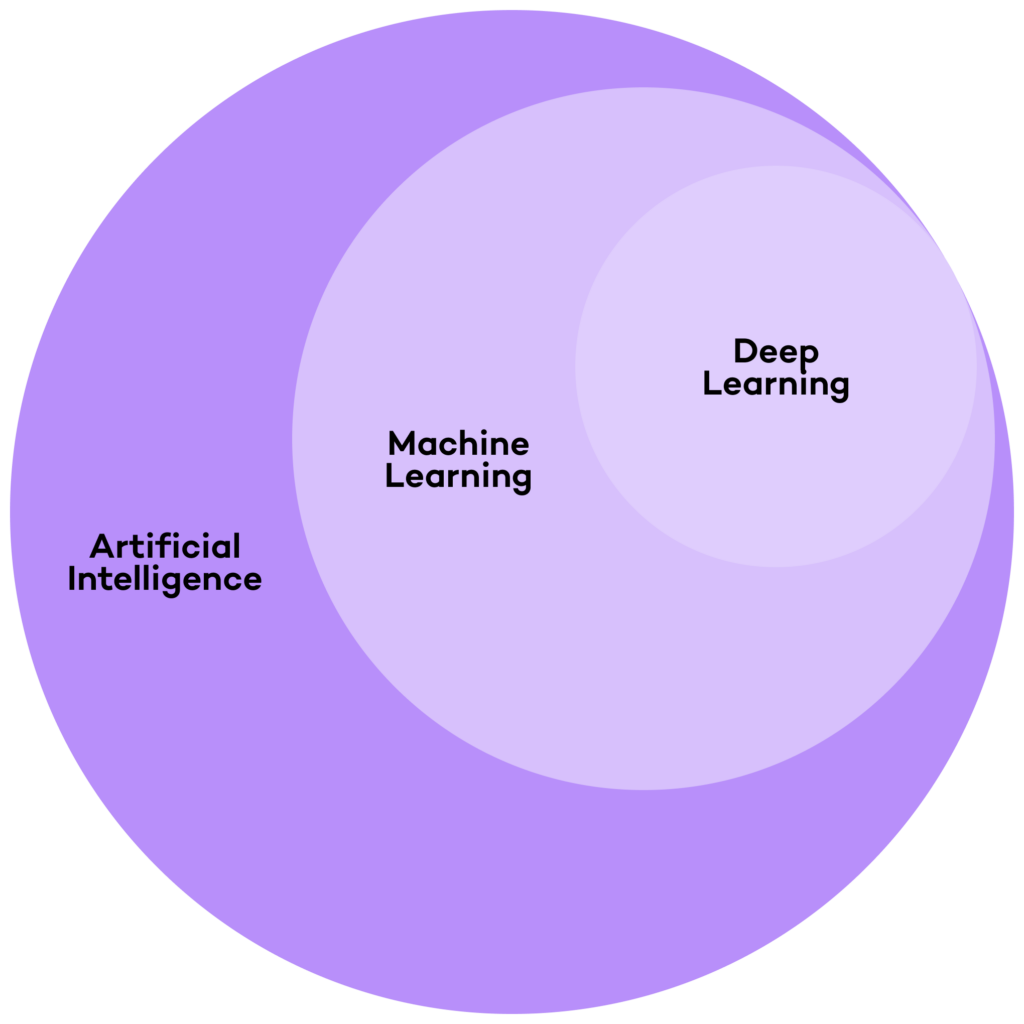

Auch wenn es einige Menschen so handhaben – „KI“, „Machine Learning“ und „Deep Learning“ synonym zu verwenden ist nicht korrekt. Sie sind zwar miteinander verwandt, aber KI ist ein Oberbegriff, der alle Technologien in diesem Bereich umfasst. Machine Learning ist eine Untergruppe der KI, und Deep Learning ist wiederum eine spezifische Untergruppe des Machine Learnings. Das bedeutet also, dass Machine Learning immer Teil der KI ist, aber nicht jede KI Machine Learning ist.

Und was ist Generative KI (Gen AI)?

Es gibt viel Verwirrung im Zusammenhang mit Generativer KI, auch bekannt als Gen AI. Sie fällt in den Bereich des Machine Learnings und ist eine Form der KI, die neue Inhalte erstellt. Diese Modelle reagieren auf Benutzereingaben in Form von „Prompts“ und sind eine Form des Deep Learnings, das im weiteren Verlauf genauer definiert wird.

Heute konzentrieren wir uns auf die ersten drei Systeme, KI, ML und DL. Wenn du deren Merkmale sowie die unterschiedlichen Ressourcen- und Infrastrukturanforderungen kennst, kannst du die richtige Wahl für ein bevorstehendes Projekt treffen, also lass uns einen genaueren Blick auf sie werfen.

Was ist Künstliche Intelligenz (KI)?

Die KI ist ein Teil der Informatik und beschreibt Computer und Maschinen, die menschliche Intelligenz nachahmen. Menschen haben die kognitive Fähigkeit, Aufgaben und Probleme zu lösen und dabei zu lernen. Die KI versucht, dieses Verhalten nachzuahmen und ist dabei in der Lage, mit Datenmengen zu arbeiten, die größer sind, als es ein Mensch jemals erfassen könnte. Bis jetzt kann KI die menschliche Intelligenz jedoch nur in der spezifischen Aufgabe nachahmen, für die sie trainiert oder designt wurde. Dazu gehört auch Generative KI, die die menschliche Fähigkeit zu denken, zu argumentieren und zu kommunizieren nachahmen kann, aber in ihrer Zuverlässigkeit auf ein bestimmtes Thema eingeschränkt ist. KI spielt eine große Rolle in vielen Bereichen: IT, Softwareentwicklung, Finanzwesen, in der Sicherheit, in der Unterhaltung und in nahezu unendlich vielen mehr.

Beispiele für KI-Anwendungen

KI-Systeme, die nicht unter das Paradigma des Machine Learning fallen, sind normalerweise regelbasiert. Das bedeutet, dass ein Mensch genau programmieren muss, wie das System auf jede mögliche Eingabe reagieren soll. Ein Beispiel für regelbasierte KI-Systeme sind sogenannte Expertensysteme, die menschliches Fachwissen nutzen, um konkrete Probleme zu lösen. In diesen Systemen legen die Programmier:innen vordefinierte Regeln fest, die vorgeben, wie das System reagieren soll, wenn es die bereitgestellten Daten verarbeitet. Expertensysteme werden eingesetzt, um Entscheidungsprozesse zu unterstützen oder Empfehlungen in verschiedenen Bereichen, wie zum Beispiel im Ingenieurwesen oder bei Finanzen, zu geben.

Als Deep Blue einen Schachweltmeister besiegte

Der berühmte Schachcomputer Deep Blue ist ein weiteres Beispiel für ein “klassisches” KI-System. Er gewann in den 90er Jahren mehrere Schachpartien und besiegte den Schachweltmeister Garry Kasparov. Deep Blue wurde mit einem enormen Wissen über Schach, einschließlich verschiedener Spielstrategien, programmiert und konnte potenzielle Spielzüge mithilfe eines regelbasierten Ansatzes abwägen und ausführen.

Ein Ausblick in die Zukunft – Artificial General Intelligence (AGI)

Artificial General Intelligence, abgekürzt AGI und im Deutschen seltener bekannt als Künstliche allgemeine Intelligenz, ist die Art von KI, die oft in Filmen zu sehen ist, zum Beispiel Scarlett Johanssons Rolle in Her oder Skynet in Terminator. AGI existiert derzeit nicht in der Realität, fällt aber dennoch unter den KI-Oberbegriff. Es ist auch ein Beispiel dafür, was KI aber nicht Machine Learning ist.

Kann die KI das Programmieren ersetzen?

Nein, oder zumindest noch nicht. KI kann Programmierer:innen derzeit nicht vollständig ersetzen. Sie kann komplexe, kontextabhängige Probleme nicht so verstehen, wie es erfahrene Menschen können. Sie ist im Allgemeinen nicht in der Lage, ihre eigenen Fehler zu finden, es sei denn, sie wird speziell dazu aufgefordert, und selbst dann findet sie sie nicht zuverlässig. Außerdem sind Menschen eher in der Lage, innovative Algorithmen oder Architekturen zu entwickeln, die an individuelle Kund:innenbedürfnisse angepasst sind. Andererseits ist die KI ein vielseitiges Werkzeug für Entwickler, da sie Code erstellen oder optimieren und Fehler im Code erkennen kann. KI-Chatbots wie Githubs Copilot, die speziell für Programmieranwendungen optimiert wurden, können Entwickler:innen echten Mehrwert bieten.

Was ist Machine Learning (ML)?

Machine Learning (ML) ist ein Bereich der KI, der Maschinen befähigt, aus großen Mengen an strukturierten und unstrukturierten Daten zu lernen. ML-Systeme folgen nicht wie andere Formen der KI einem vordefinierten Regelsatz, wie es beispielsweise die Expertensysteme tun. Stattdessen lernen ML-Algorithmen, Muster in den Trainingsdaten zu erkennen und können anschließend verwendet werden, um Vorhersagen auf der Grundlage dieser Muster zu treffen, wenn ähnliche Daten vorliegen. Im Allgemeinen eignet sich jede ML-Architektur und jeder Algorithmus am besten für eine bestimmte Art von Problem. Zum Beispiel benötigt man einen anderen Algorithmus, um Vorhersagen über zukünftige Ereignisse zu treffen, als um Objekte in Bildern zu identifizieren. Um den richtigen ML-Algorithmus auszuwählen und die Daten entsprechend vorzubereiten, ist in der Regel ein menschlicher Experte erforderlich.

Wie präzise kann Machine Learning vorhersagen?

Machine Learning ist keine Kristallkugel. Es kann nicht alles vorhersagen, was in der Zukunft passiert, da unsere Umgebung ständig im Wandel ist. In der Natur, der Politik und vielen anderen Bereichen werden immer unerwartete Ereignisse oder Handlungen auftreten. Nur weil mehr vergangene Daten zur Verfügung gestellt werden, bedeutet das nicht, dass ein ML-System die Zukunft genauer vorhersagen kann. Man darf nicht vergessen, dass ein ML-System auf einem bestimmten Datensatz trainiert wird und damit implizite Annahmen über die Welt macht, in der es die Vorhersagen trifft. Wenn sich die Bedingungen, unter denen die Trainingsdaten entstanden sind, ändern, wird das System kein akkurates Verständnis dieser Welt mehr haben, und seine Vorhersagen werden nicht mehr zuverlässig sein.

Praktische Anwendungsfälle des Machine Learnings

Vorausgesetzt, dass genügend Daten zur Auswertung vorliegen, können ML-Systeme bis zu einem gewissen Grad die Zukunft vorhersagen. Sie erkennen bestimmte Muster in den Daten und können Anomalien erkennen. Aus diesem Grund gehört die Vorhersage zu den beliebtesten Anwendungsfällen, beispielsweise in Form der Sales-Prognose. In diesem Fall lernt der Algorithmus die saisonalen Nachfragetrends. Auch Produktempfehlungen können durch ein ML-System verbessert werden. Amazon empfiehlt seinen Nutzern beispielsweise neue Produkte auf Grundlage ihrer Such- und Kaufhistorie und zeigt zudem Produkte an, die von Personen mit ähnlichen Interessen gekauft wurden. In diesem Fall erkennt der Algorithmus Muster in Gruppen von Artikeln, die häufig zusammen gekauft werden oder ähnliche Merkmale aufweisen. Im Banken- und Finanzsektor werden ML-Systeme zudem zur Betrugserkennung eingesetzt.

Was ist der Unterschied zwischen KI und Machine Learning?

Technisch gesehen gibt es keinen Unterschied zwischen ihnen, da ML ja einen Teil der KI bildet. Aber was ML von anderen Formen der KI unterscheidet, ist, dass ML-Systeme speziell für die Mustererkennung entwickelt wurden, um Vorhersagen auf Basis großer Datensätze zu treffen. KI, die kein ML ist, muss explizit programmiert werden, wie zum Beispiel im Fall von Deep Blue.

Was ist Deep Learning (DL)?

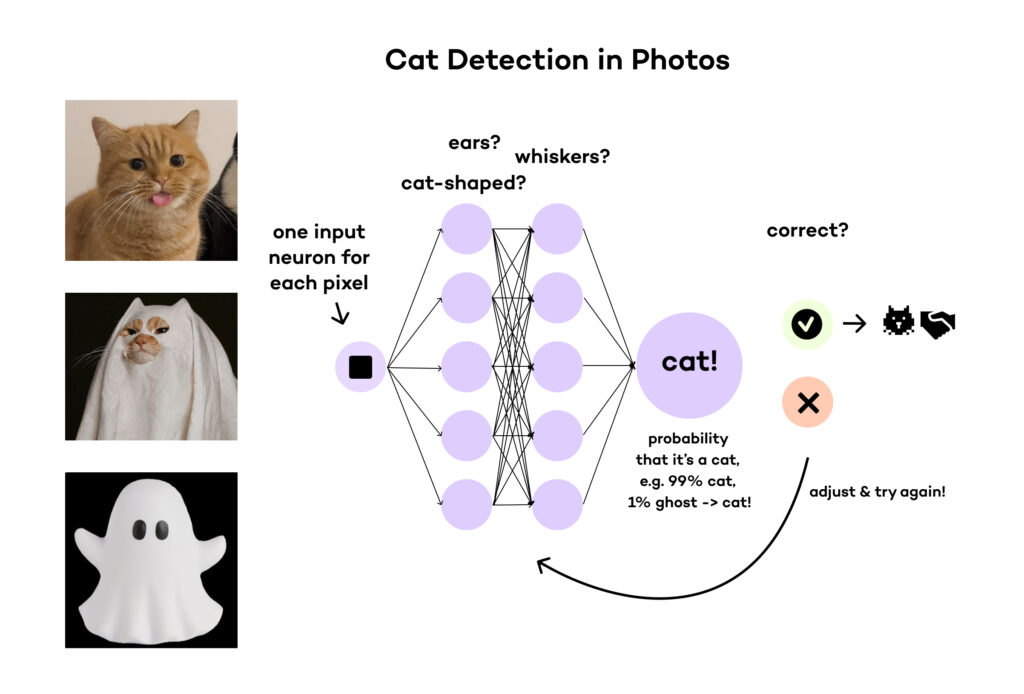

Deep Learning kann enorme Mengen an strukturierten und unstrukturierten Daten verarbeiten. Es basiert immer auf der Architektur eines sogenannten „künstlichen neuronalen Netzwerks“, das eine Form des Machine Learnings ist.

Was sind künstliche neuronale Netze (KNN) und wie funktionieren sie?

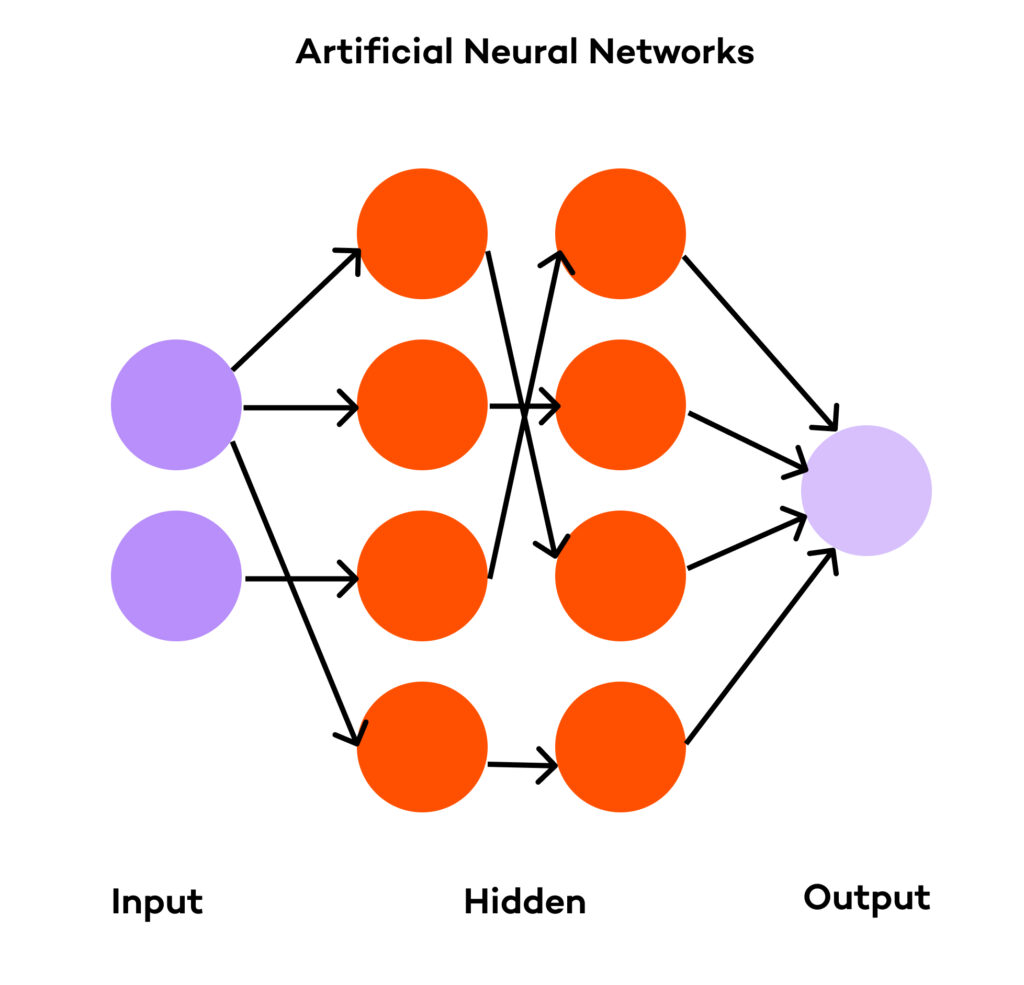

Künstliche neuronale Netze sind von den Netzwerken des Gehirns inspiriert. Die „Neuronen“ eines KNNs sind durch sogenannte Gewichte verbunden, die mit den Synapsen des Gehirns vergleichbar sind, und sie sind in Schichten (layers) gruppiert. Die einfachste Klassifikation dieser Schichten unterteilt sie in die erste, die Eingabeschicht (input layer), alle dazwischenliegenden versteckten Schichten (hidden layer) und die letzte, die Ausgabeschicht (output layer). Informationen werden vom Eingang bis zum Ausgang durch das Netzwerk weitergeleitet.

Die Eingabeschicht

Die erste Schicht stellt eine Reihe von Merkmalen dar, die die Eingabe definieren. Zum Beispiel kann ein Sales-Prognosesystem Eingabemerkmale wie den Tag des Jahres, den Wochentag oder die Frage, ob es sich um einen Feiertag handelt, enthalten.

Die Ausgabeschicht

Die letzte Schicht stellt die Merkmale dar, die das Modell vorhersagen soll. Im Beispiel der Sales-Prognose wäre dies das Verkaufsvolumen.

…und was passiert dazwischen?

Jedes Neuron in einer Schicht ist mit jedem Neuron der vorherigen und der nächsten Schicht verbunden, wobei die Stärke dieser Verbindungen durch die zuvor erwähnten Gewichte dargestellt wird. Während die Eingabedaten durch das Netz fließen, werden die Werte dieser Gewichte schrittweise aktualisiert. Jedes Mal, wenn die Trainingsdaten dem Netz zugeführt werden, spricht man von einer Epoche. Dabei verändern sich die Gewichte ein wenig, sodass die vorhergesagten Ausgaben näher an den tatsächlichen Werten liegen. Dieser Prozess wird fortgesetzt, bis sich der Fehler bei den Vorhersagen auf den Trainingsdaten einpendelt. An diesem Punkt gilt das Modell als trainiert und hat die Muster in den Daten erlernt.

In welchen Bereichen spielt Deep Learning eine Rolle?

Deep Learning ist allgegenwärtig im Bereich der Computer Vision, die es Maschinen ermöglicht, visuelle Informationen aus der Welt zu interpretieren und zu verstehen. Konkrete DL-Anwendungsfälle in der Computer Vision sind beispielsweise die Gesichtserkennung zur Sicherheitsüberprüfung oder die Objekterkennung im autonomen Fahren, wie etwa die Erkennung von Verkehrsschildern. Ein spannender Anwendungsfall der Objekterkennung ist die Tumorerkennung bei Krebspatienten, wobei DL als diagnostisches Werkzeug fungiert. Auch die Umwandlung von Bildern in Texte, autonome Fahrzeuge und Robotik sind gängige Anwendungen der Computer Vision.

Was ist der Unterschied zwischen Deep Learning und Machine Learning?

Deep Learning ist nicht die einzige Form des Machine Learning, die eine neuronale Netzarchitektur nutzt. Was Deep Learning von anderen künstlichen neuronalen Netzwerken jedoch unterscheidet, ist die Anzahl der versteckten Schichten. Deep-Learning-Modelle haben Hunderte oder sogar Tausende versteckter Schichten. Aufgrund dieser hohen Anzahl an Schichten benötigen DL-Modelle wesentlich mehr Daten für das Training und verbrauchen deutlich mehr Rechenressourcen als klassische ML-Algorithmen. Indem sie komplexere Muster in den Daten erkennen, können sie wesentlich schwierigere Probleme lösen.

Kannst du deine eigene KI-Anwendung entwickeln?

Ob du User, in der Entwicklung oder in der Geschäftsleitung tätig bist – ein grundlegendes Verständnis dieser Technologien hilft dabei, nachzuvollziehen, was im Hintergrund passiert, wenn du sie nutzt. Wenn du eine eigene KI-Anwendung für bestimmte Aufgaben benötigst und zwischen verschiedenen Systemen wählen musst, ist es von Vorteil, deren Kompetenzen zu Beginn vergleichen zu können. Bei diconium data arbeiten unsere Expert:innen mit unterschiedlichsten Datenmengen um die passenden Lösungen für unsere Kund:innen zu finden. Wenn du mehr über uns erfahren möchtest, kontaktiere uns gerne!